近日,阿里云人工智能平台PAI正式发布自研的DeepRec Extension(即DeepRec 扩展),旨在以更低成本,更高效率进行稀疏模型的分布式训练。DeepRec Extension 在 DeepRec 训练推理框架之上,围绕大规模稀疏模型分布式训练,创新性地从训练任务的视角提出了自动弹性训练和分布式容错功能,进一步提升稀疏模型训练的整体效率,助力 DeepRec 引擎在稀疏场景中发挥更大的优势。

DeepRec Extension 有效地解决了企业级场景大规模稀疏模型训练中的难点。随着业务发展,模型尺寸增长到百GB / TB 量级,分布式训练往往会遇到分布式建模接口复杂、资源预估困难且无法弹性、分布式容错机制过于简单和分布式环境复杂等问题,阻碍大尺寸模型高效、稳定地完成训练。DeepRec Extension 提供易用、高效、高性价比的框架,使得模型能够便捷地在分布式环境中运行,切实解决上述问题。

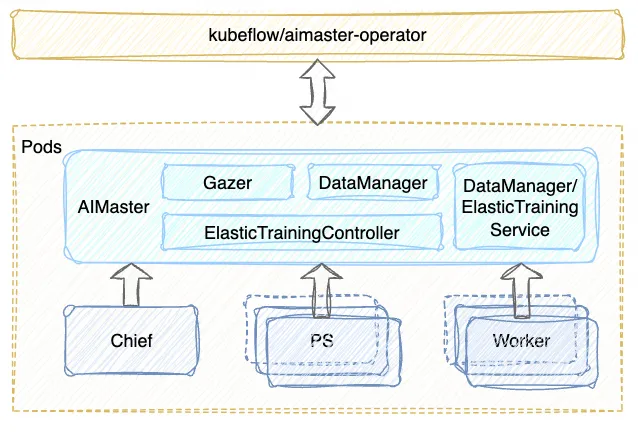

DeepRec Extension 设计思路及整体架构

DeepRec Extension 推出分布式训练资源预估、自动弹性训练、资源/计算图监控、自动备份容错等功能,有效降低了大规模稀疏模型训练的技术门槛和成本,同时提升了分布式训练的效率和稳定性。DeepRec Extension 简化分布式训练的工作流程,保障用户聚焦于模型的构建阶段,更加专注于模型本身的创新与优化,无需关注繁琐的底层架构配置。在性能提升方面,资源预估以及自动弹性训练为用户节约 20% ~ 60% 资源,在稳定性方面,PS 发生异常后,模型 E2E 训练吞吐提升 10%。

一直以来,大规模稀疏模型分布式训练是备受关注的话题,阿里云人工智能平台PAI正式将DeepRec Extension 开源,与AI开发者共同打造更快更好的分布式训练框架,全面助力AI大模型发展!

开源地址:https://github.com/DeepRec-AI/extension